Ciao,

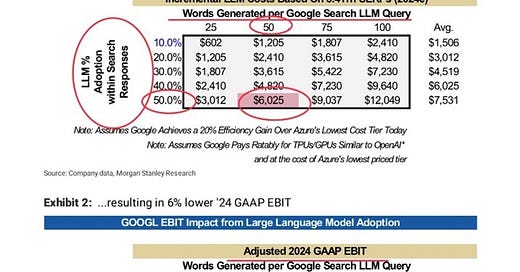

sono passati ormai quattro mesi dal lancio di ChatGPT e non ho ancora sentito parlare di nessuno che abbia perso il lavoro a causa di un’intelligenza artificiale. A pensarci bene, qualcuno in Google forse potrebbe essere stato licenziato dopo il lancio fallimentare in pompa magna di “Brad” (la risposta di Google a ChatGPT) , ma non erano quelli i p…

Continua a leggere con una prova gratuita di 7 giorni

Iscriviti a Segui i mangoddi per continuare a leggere questo post e ottenere 7 giorni di accesso gratuito agli archivi completi dei post.